Intel开源NPU加速库,酷睿Ultra处理器AI PC可运行轻量级大语言模型

|

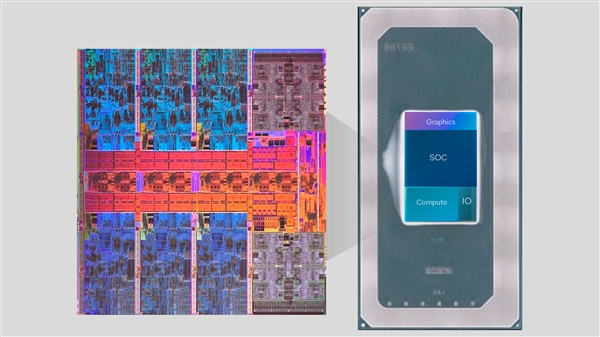

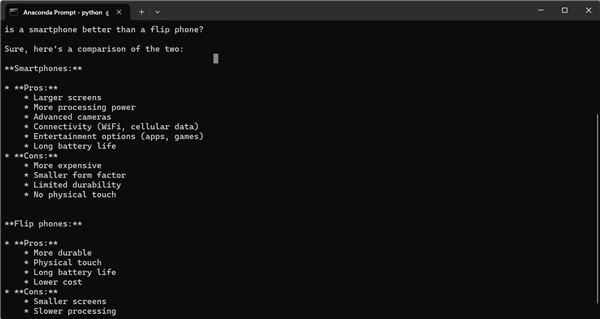

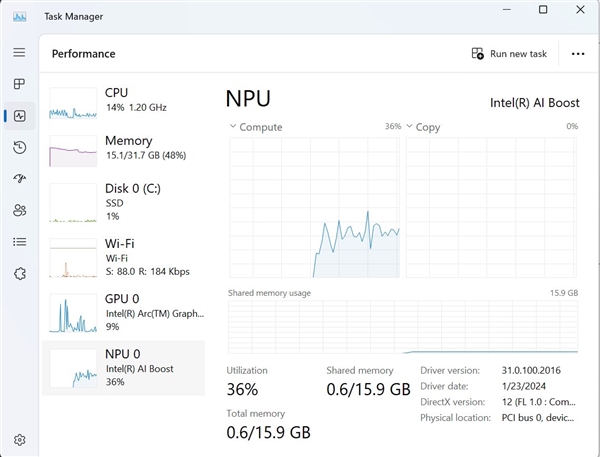

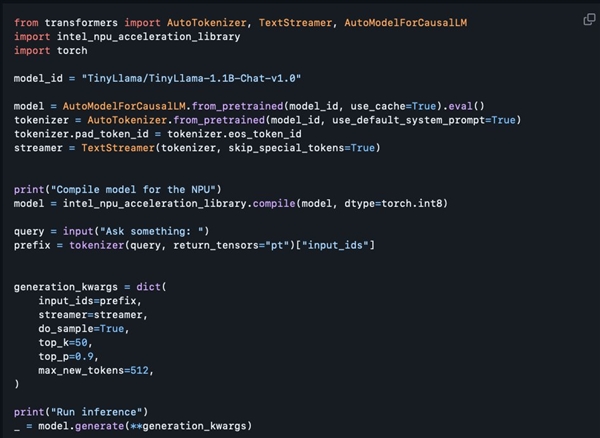

3月4日消息,近日,Intel在GitHub上公开了其NPU加速库,这一举措使得装备了酷睿Ultra处理器的AI PC得以流畅运行诸如TinyLlama、Gemma-2b等轻量级大型语言模型。 酷睿Ultra系列首次集成了NPU AI引擎,该引擎能够处理一些轻量级的AI推理任务,并与CPU、GPU协同工作,以应对各类AI应用的需求。 据本站了解,虽然这次开源的NPU加速库主要针对开发人员,但拥有一定编程经验的用户同样可以尝试使用。Intel的软件架构师Tony Mongkolsmai展示了如何利用此开源库,在微星尊爵14 AI Evo笔记本电脑上运行一个基于11亿参数的TinyLlama大模型的AI聊天机器人,该机器人能进行简单的对话。同时,Windows任务管理器也证实了NPU的有效调用。 然而,当前的开源NPU加速库在功能上还存在一些不足,它支持8比特量化和FP16精度,但尚不支持4比特量化、BF16精度以及NPU/GPU的混合计算等高级功能,且相关技术文档也尚未提供。不过,Intel已承诺将在后续逐步扩展其功能,预期将比现有功能增加一倍,这无疑将为AI开发者们带来更多的便利和可能性。 |